ההתקדמות הטכנולוגית המהירה משיגה את האבולוציה, שבמסגרתה התפתחו הרגשות שלנו. האם בינה מלאכותית תיזקק להם? ואנחנו?

X זמן קריאה משוער: 10 דקות

אנשים הם רגשנים – כך כבר אלפי שנים. תת-המערכת הרגשית שלנו היא חלק מהותי מכל החלטה שלנו, ולעתים היא מכתיבה אותה בלי ידיעתנו. הרגשות נעים מעומק תאי העצב שבמעינו, דרך העצב התועה ישירות על המוח.

אתם אולי חושבים שהרגשות הם החלק הפרימיטיבי של מוחנו, שריד נושן מתקופה שבה היינו מתורבתים פחות. וזה נכון, חלקית, אבל גם מוטעה מאוד.

נכון שרגשות, תחושות בטן, וקבלת החלטות אינטואיטיביות נוצרו בזמנים שבהם בני אדם התפתחו בסביבה אכזרית יותר. מטרתם העיקרית הייתה לאפשר החלטות מהירות. ורגשות הם בעיקרם דחיסה של גירויים חושיים רבים ממקורות רבים לכדי תגובה פשוטה, מהירה להפליא, המתעוררת עם הופעתו של הגורם המעורר.

בערים המודרניות אין נמרים האורבים בעשב, ולכן תפקידם של הרגשות צריך היה להצטמצם לעומת החשיבה ההגיונית, אך הדבר נכון חלקית בלבד

כאשר בסוואנה הקדמונית נשמעה שאגה מתוך היער בערב חשוך וגשום, לחלק הרציונלי האיטי יותר של המוח לא היה זמן להעריך את המצב. כדי לשרוד, צריך היה לברוח – ומהר. ואולם, ניתן לציין בצדק שבערים המודרניות אין נמרים האורבים בעשב, ולכן תפקידם של הרגשות צריך היה להצטמצם לעומת החשיבה ההגיונית. ושוב – הדבר נכון חלקית משתי סיבות.

מערכת DALL-e2 התבקשה לצייר "רגש נמר סוואנה", אבל רגשות אין לה וגם לא זיכרון קדום של סכנה נוכח נמרים בסוואנה.

הראשונה היא שעל אף העובדה שהתרבות התפתחה במהירות אדירה במהלך מאתיים שנה בלבד, המוח שלנו לא עשה זאת. והשנייה היא שלרגשות ישנו תפקיד נוסף, חשוב ביותר. סוציאליזציה.

במוח האנושי ישנו מערך מיוחד של תאי עצב הקרויים נוירוני מראה. הנוירונים הללו עומדים בבסיס יכולתנו לחוש אמפתיה כלפי אחרים, שהיא בתורה הבסיס לסוציאליזציה. שום חברה אנושית, מודרנית או עתיקה, לא הייתה יכולה להיווצר ללא אמפתיה, היכולת לחוש ולהבין את מצבם הרגשי של בני אדם אחרים.

חוקר המוח, הרופא ד"ר ג'קומו ריצולטי (Rizzolatti), שיחד עם עמיתיו באוניברסיטת פרמה זיהו לראשונה נוירוני מראשה, אומר שהנוירונים עשויים לסייע להסביר כיצד ומדוע אנו 'קוראים' את ה-mind של אנשים אחרים ומרגישים כלפיהם אמפתיה. אם להביט בפעולה ולבצע את הפעולה עשויים להפעיל את אותם החלקים במוח אצל קופים - עד לרמת הנוירון הבודד - סביר שלצפות בפעולה ולבצע פעולה יעוררו רגשות זהים אצל בני אדם (כתב העת של האגודה הפסיכולוגית האמריקנית, 2005).

אבל זה לא הכול.

כללים וחוקים חברתיים הם בעצמם מבוססי אמפתיה. למה שלא נרצח, נגנוב או נחמוד את אשת רענו? החוקים העתיקים הללו נובעים ישירות מכך שבני אדם מבינים (ומרגישים) את הרגשות של בני אדם אחרים

כללים וחוקים חברתיים הם בעצמם מבוססי אמפתיה. קחו למשל את עשרת הדיברות. למה שלא נרצח, נגנוב או נחמוד את אשת רענו? החוקים העתיקים הללו נובעים ישירות מכך שבני אדם מבינים (ומרגישים) את הרגשות של בני אדם אחרים. כאב הנרצח, ייסורי הנבגדים או מי שגנבו מהם. ללא רגשות, בלי תחושות, חוקים כאלה לא היו נולדים לעולם.

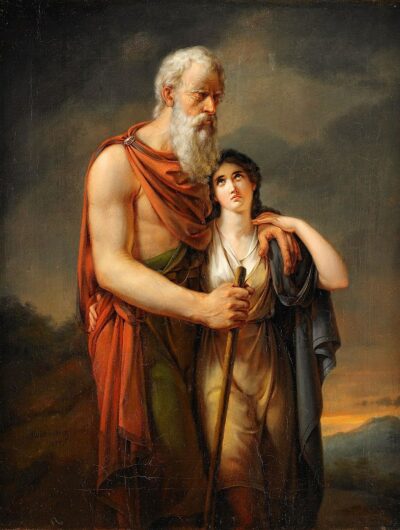

רגשות של בני-אדם שורשיהם עמוקים והשפעתם רב-דורית. מכונה לא תבין זאת, אין לה סיבה. "אדיפוס ואנטיגונה" (1833), פר גבריאל ויקנברג. תצלום: ויקיפדיה

למידה ותשומת לב

ידוע כי טראומה גורמת למוח להטמיע עמוקות את הזיכרון הטראומתי ואת מה שמעורר אותו (הטריגר). זהו מנגנון למידה, המאפשר למוח ליצור תגובות רגשיות עזות למצבים מסוכנים, אשר במפגש עתידי איתם יגרמו לסובייקט להגיב במהירות לסימנים, בתקווה לשמור עליו מפני סכנה.

מנגנון הלמידה הזה חורג מן האירועים הטראומטיים והוא משמש כשאנחנו לומדים, במצבים חברתיים שמלמדים אותנו כיצד להגיב נכונה לאחרים, וכאשר אנו נבהלים ממכונית שכמעט דורסת אותנו כשאנו חוצים את הכביש בזמן שאנו שקועים בחלום בהקיץ.

רגשות קשורים מהותית ומשפיעים על יכולות קוגניטיביות כמו תשומת לב, זיכרון, תפקודים ניהוליים, קבלת החלטות, חשיבה ביקורתית, ויסות ופתרון בעיות, שכולם ממלאים תפקיד מרכזי בלמידה. יצירת מודל מנטלי של העולם הרב היבטי שסביבנו, מושפעת עמוקות על ידיהם וכך גם תשומת הלב, החיונית לסינון החלקים הנכונים מתוך שפע הקלט החושי המקיף אותנו, כדי ליצור דגם שימושי.

ללא רגשות ותשומת הלב הנגזרת מהם אנחנו דומים לספינה האובדת בים החשוך ללא חוש כיוון, ללא הגה המנווט את המוח אל המודלים היעילים ביותר האפשריים, כאלה שיאפשרו לנו לנהל בבטחה תהליכים של קבלות החלטות שעמם אנו מתמודדים בכל רגע ורגע

ללא רגשות ותשומת הלב הנגזרת מהם אנחנו דומים לספינה האובדת בים החשוך ללא חוש כיוון, ללא הגה המנווט את המוח אל המודלים היעילים ביותר האפשריים, כאלה שיאפשרו לנו לנהל בבטחה תהליכים של קבלות החלטות שעמם אנו מתמודדים בכל רגע ורגע.

אבל, בינה מלאכותית (AI), כפי שהיא כיום, אינה זקוקה לדבר מכל זה (ארחיב בהמשך).

לרגש יש השפעה משמעותי על התהליכים הקוגניטיים אצל בני אדם, כולל פרצפציה, תשומת לב, למידה, זיכרון, היסק ופתרון בעיות. לרגש יש השפעה חזקה במיוחד על תשומת הלב, בעיקר בכך שהוא משנה את הסלקטיביות של תשומת הלב ומניע פעולה והתנהגות. הבקרה הזאת קשורה קשר הדור לתהליכי למידה, שכן יכולות תשומת לב מוגבלות באורח פנימי ממוקדות טוב יותר במידע רלוונטי. הרגש גם מאפשר קידוד ומסייע בשליפה יעילה של מידע (מתוך The Influences of Emotion on Learning and Memory, Frontiers, 2017)

בינה מלאכותית לומדת

מערכות מודרניות של בינה מלאכותית לומדות מכמויות עצומות של נתונים. ChatGPT, הצ׳טבוט שהתפרסם מאוד לאחרונה, הוזן בכמויות אדירות של טקסט מהרשת, ולמד כיצד נבנים משפטים ואיך ליצר המשכיות של טקסט משורות ספורות שניתנות לו. בעיקרו, זהו מודל שיודע להשלים משפטים (auto-complete machine) היודע להשתמש בפלט שלו עצמו כדי להמשיך ליצור עוד ועוד טקסט ללא הפסקה.

הדבר נכון גם לגבי מודלים אחרים של בינה מלאכותית כמו Stable Diffusion או DALL-e2 אשר מייצרים דימויים שנראים אמנותיים בתגובה למספר שורות של טקסט תיאורי. מודלים כאלה של בינה מלאכותית למדו כיצד ליצור דימויים על ידי התבוננות בכמות גדולה של דימויים קיימים ובטקסטים הקשורים אליהם.

מערכת DALL-e2 התבקשה לייצר ציור של "בינה מלאכותית רגשית", וזה מה שהאלגוריתם הפיק.

יתרה מזאת, הרשת העצבית המהווה בסיס למודלים כאלה נבנה על פי מושג פשוט של תשומת לב (הדומה במידת מה למושג תשומת הלב של בני האדם), שעל פיו הבינה המלאכותית לומדת להבחין בין החלקים החשובים בנתונים ובין הרעש, דבר המאפשר למודל להפוך למדויק יותר.

עבור המודל, אין כל הבדל בין חתול או מונה ליזה שהוא מייצר, ואילו אדם הצופה בשני הדימויים יחוש שתי תגובות רגשיות שונות מאוד

אף שהמודלים הללו הם מרשימים (ומעוררים התלהבות מוגזמת), אי אפשר לטעון שהם באמת מבינים את הפלט שלהם, או את התוכן הרגשי בטקסטים או בדימויים שהם מייצרים. עבור המודל, אין כל הבדל בין חתול או מונה ליזה שהוא מייצר, ואילו אדם הצופה בשני הדימויים יחוש שתי תגובות רגשיות שונות מאוד.

האם בינה מלאכותית זקוקה לרגשות?

שימו לב שישנו הבדל קל בין השאלה אם אנחנו מסוגלים לבנות בינה מלאכותית שתבין רגשות או תחווה רגשות, לבין שאלת הצורך המהותי שלה בתת-מערכת רגשית. בואו נבחן את השאלה השנייה קצת יותר לעומק.

האם משהו מכל הסיבות האבולוציוניות שהביאו להתפתחות מערכת רגשית בבני אדם הוא חיוני למערכת בינה מלאכותית? התשובה היא לא. והנה הנימוקים.

מערכות בינה מלאכותית אינן חשופות ללחצים אבולוציוניים שבני האדם נאלצו להתמודד איתם כדי לשרוד בסוואנה הקדמונית. שום נמרים אינם אורבים בין הכבלים כדי לבתר מערכת עצבית עמוקה שמפעילה מודל שפה או מודל ויזואלי גדול. יתרה מכך, המהירות החישובית של מודל בינה מלאכותית אינה בעייתית, ולכן אין צורך באופטימיזציה של זמן התגובה וגם אין צורך ברגשות כדי ליישם תשומת לב (לא נתאר כאן כיצד מיושמת תשומת לב ברשתות עמוקות משום שהדבר חורג מהיקפו של מאמר זה) או כדי להעצים את החוויה הרגשית כדי שהיא תיזכר בצורה טובה יותר (כלומר, תילמד).

אם מודלים של בינה מלאכותית נבנים ללא הבנה של רגשות, לא ניתן לצפות שהם יבינו בני אדם וגם לא שייצרו איתם אינטראקציות אופטימליות

לכן אין פלא שהמודלים המשוכללים הנוכחיים של בינה מלאכותית הם חסרי רגשות. הם פשוט לא זקוקים לכך, ומהנדסים חורגים רק לעתים נדירות מן הצרכים המיידיים. אבל זה לא כל כך פשוט: אם מודלים של בינה מלאכותית נבנים ללא הבנה של רגשות, לא ניתן לצפות שהם יבינו בני אדם וגם לא שייצרו איתם אינטראקציות אופטימליות.

קחו למשל בינה מלאכותית – לא מאוד בדיונית – המשמשת כרופאה (ChatGPT עבר לאחרונה את בחינות הרישוי לרפואה בארצות הברית). האם רופאת-AI תהיה מסוגלת להבין באמת מטופל אנושי בלי שתוטמע בה אינטליגנציה רגשית? כיצד היא תנהג באדם שאומר משהו כמו ״דוקטור, אני מרגיש שמשהו איתי לא בסדר, לאחרונה אני לא עצמי״? איך היא תוכל להבין לעומקו את המצב הנפשי והגופני של חולה בלי אמפתיה, בלי לקרוא את שפת הגוף שלה ואת הבעות פניה, את כלל הפלט הרב ממדי שלה? כששואלים את השאלות האלה את ChatGPT הנוכחי, מקבלים את התשובה הבאה, שהיא... גנרית למדי.

שאלה: דוקטור, אני מרגיש שמשהו איתי לא בסדר, לאחרונה אני לא עצמי

תשובה: אני מצטערת לשמוע. אתה יכול לתאר את התסמינים שחווית או שינויים כלשהם שבהם הבחנת, בהתנהגות או רגשות? כדאי גם שתיגש לבדיקה אצל רופא או מומחה מתחום רפואה הנפש. הם יוכלו לקבוע אם ישנה בבסיס העניין בעיה רפואית או נפשית, אשר.

אם טרם השתכנעתם, הרשו לי לנסות דוגמה נוספת. נגיד שאתם צופים בנטפליקס ומנסים למצוא משהו חדש ומעניין. הרצונות שלכם מושפעים מאוד ממצבכם הרגשי הנוכחי. אולם מערכת המלצות המבוססת על בינה מלאכותית אינה מתחשבת בכך כשהיא מציעה סדרת טלוויזיה או סרט חדש. כתוצאה מכך, כנראה תחשבו (בצדק) שמערכת ההמלצות של נטפליקס, המבוססת על בינה מלאכותית, גרועה ביותר. האם מערכת ההמלצות צריכה להפוך לרגשנית? לא בהכרח, אולם צריך שתהיה לה הבנה מסוימת של רגשות אנושיים כדי שתוכל להשתפר ולא רק לשגר אליכם המלצות על עוד ועוד תכנים זהים כפי שקורה כעת.

ואנחנו יכולים להמשיך, אבל נדמה לי שהבנתם.

אם צפינו בסרט אימה אמש, האם יש למערכת דרך לדעת מה מתאים לנו רגשית היום? שנרצה עוד? ואולי נרצה נוגדן רומנטי מתקתק? בוריס קרלוף בסרט "פרנקנשטיין" (1931). תצלום: Insomnia Cured Here

מוסר ואתיקה

מוסר הוא נושא שנידון מימים ימימה בפילוסופיה העתיקה והמודרנית. כשלומדים כתבים פילוסופיים שונים העוסקים במוסר, מתקבלת ההרגשה כי איש מהכותבים לא ממש הצליח לקלוע למטרה. הסיבה לכך היא שמוסר נובע מעומק תת המערכת האמפתית במוחנו, וכפי שהראינו קודם, זו קשורה הדוקות לחלקים הרגשיים של מוחנו, ולכן אין תשובה (מוסרית) אחת המתאימה לכול, אף שבני האדם באשר הם חולקים לרוב את אותם כללי מוסר.

לבינה המלאכותית, לעומת זאת, אין בשלב זה תת מערכת אמפתית. איך נוכל לצפות ממנה לקבל החלטות מוסריות התואמות את מושגי המוסר המשותפים לנו?

קחו למשל את המכוניות האוטונומיות. המכוניות ללא-נהג של מרצדס מתוכנתות להעדיף את נהגיהן. כלומר, מהנדס (שבוודאי מעולם לא למד פילוסופיה) החליט שלדרוס ילד זו החלטה טובה יותר מלהניח למכונית להתנגש בעץ לצד הדרך, אף שמערכות הבטיחות של מכוניות מודרניות בוודאי מסוגלות במקרה כזה להציל את חיי הנהג וגם למנוע סכנה מהילד.

האם זו הבינה המלאכותית שאנו רוצים שתנהל חלק גדול מחיי היומיום שלנו?

אנחנו לא יכולים פשוט להסתדר אלה עם אלה?

אם הבינה המלאכותית תמשיך להתפתח באותו כיוון, חסרת רגשות וחסרת אמפתיה, האם נוכל בכלל לתקשר איתה? או לשנות את התנהגותה כך שתתאים למה שאנו, כבני אדם, מגדירים כהחלטות נכונות? האם מערכות בינה מלאכותית עתידיות יפתחו שפה שבה נוכל לחנך ולעצב אותן לראות את העולם באופן הדומה יותר לראיית העולם האנושית, או שהן פשוט ימשיכו, עליזות וטובות לב, בדרכן האידיוסינקרטית?

נראה שהבינה המלאכותית והאנושות צועדות בשתי דרכים נפרדות, ואם הללו יצטלבו עשוי להיוולד עולם חדש ואמיץ. אולם אם הבינה המלאכותית תישאר בידי מהנדסים, ניווכח בוודאי ששתי הדרכים הללו יתרחקו זו מזו מרחק רב

מערכת ראשונית שנוצרה על ידי FAIR (מעבדת הבינה המלאכותית של פייסבוק) מעניקה הצצה אל מה שעשוי לקרות אם נבנה מערכות כאלה בלי המגבלות הללו.

פייסבוק סגרה את מנוע הבינה המלאכותית שלה לאחר שהמפתחים גילו שהבינה המלאכותית יצרה לשון משלה שבני-אדם אינם מסוגלים להבין אותה. חוקרים במעבדת FAIR של פייסבוק גילו שהצ'ט-בוטים סטו מהתסקיט ותקשרו בשפה חדשה שפותחה ללא קלט אנושי. העניין היה מדאיג באותה מידה שהוא היה מדהים - הצצה בו-זמנים לפוטנציאל המטלטל וגם מזרה האימים של הבינה המלאכותית. (מתוך: Facebook AI Creates Its Own Language, פורבס 2017)

במצב הנוכחי, נראה שהבינה המלאכותית והאנושות צועדות בשתי דרכים נפרדות, ואם הללו יצטלבו עשוי להיוולד עולם חדש ואמיץ. אולם אם הבינה המלאכותית תישאר בידי מהנדסים, ניווכח בוודאי ששתי הדרכים הללו יתרחקו זו מזו מרחק רב.

האם בני האדם יתפתחו (או יחזרו לאחור) באופן שיאפשר להם להסתדר עם המכונות? או שהלודיטים יצוצו שוב, ככוח נגדי למהפכה חסרת רסן של בינה מלאכותית ששכחה שהיא אמורה לשרת את המין האנושי? זאת נדע עם הזמן.

תמונה ראשית: ציור של רגש באמצעות בינה מלאכותית, DALL-e2. הציור בוצע מתוך החשבון של עורך "אלכסון" ב-DALL-e2.

מחשבות מתחילות כאן

מחשבות מתחילות כאן

תגובות פייסבוק

2 תגובות על מי צריך רגשות?

ומה אם האדם יקבל על עצמו הובלה אמוציונאלית והמכונה תיקח את ההובלה הרציונאלית?

https://alaxon.co.il/article/%d7%a0%d7%a9%d7%91%d7%a2-%d7%9c%d7%9a-%d7%91%d7%90%d7%a4%d7%9c%d7%99%d7%a7%d7%a6%d7%99%d7%94/

החלקים האמוציונלים והרציונלים שלובים זה בזה. נסיון להפריד אותם ייצור סוג חדש של סכיזופרניה (האסוציאציה הציורית שלי היא לתהליך הקיטוע בספר מצפן הזהב) והתפרקות ה"אני". ע"ע מחקר על מרכז ה-aPcu במוח (סטנפורד, פורסם ב8 ליוני השנה) המראה שתחושת העצמי נובעת משילוב של קלטים מכל חלקי המוח ומערכת העצבים.

השעמום הוא חלון אל השמש

ניל ברטוןהתחושה המוכרת לכולנו, מסתורית, מעיקה ואפילו מתמשכת, היא גם הזדמנות לגלות את...

X 7 דקות

קולו של אני

דון מיגל רואיס וברברה אמריסכל חיינו אנחנו נאחזים בסיפורנו האישי. הקול הפנימי מדבר, מספר, מנתח ומצטדק,...

X רבע שעה

שבע הערות על מקומן של הדתות בעולם

דניאל אראלמה בין חוויית הפלא והקסם שאנו עשויים לחוש בכל עת, בכל מקום,...

X 5 דקות